Das Beste kommt noch

Mit der künstlichen Intelligenz ging es nur langsam voran – in den ersten 75 Jahren. Jetzt explodiert ihre Leistungsfähigkeit. Das erschreckt viele, verspricht aber auch eine bessere Zukunft

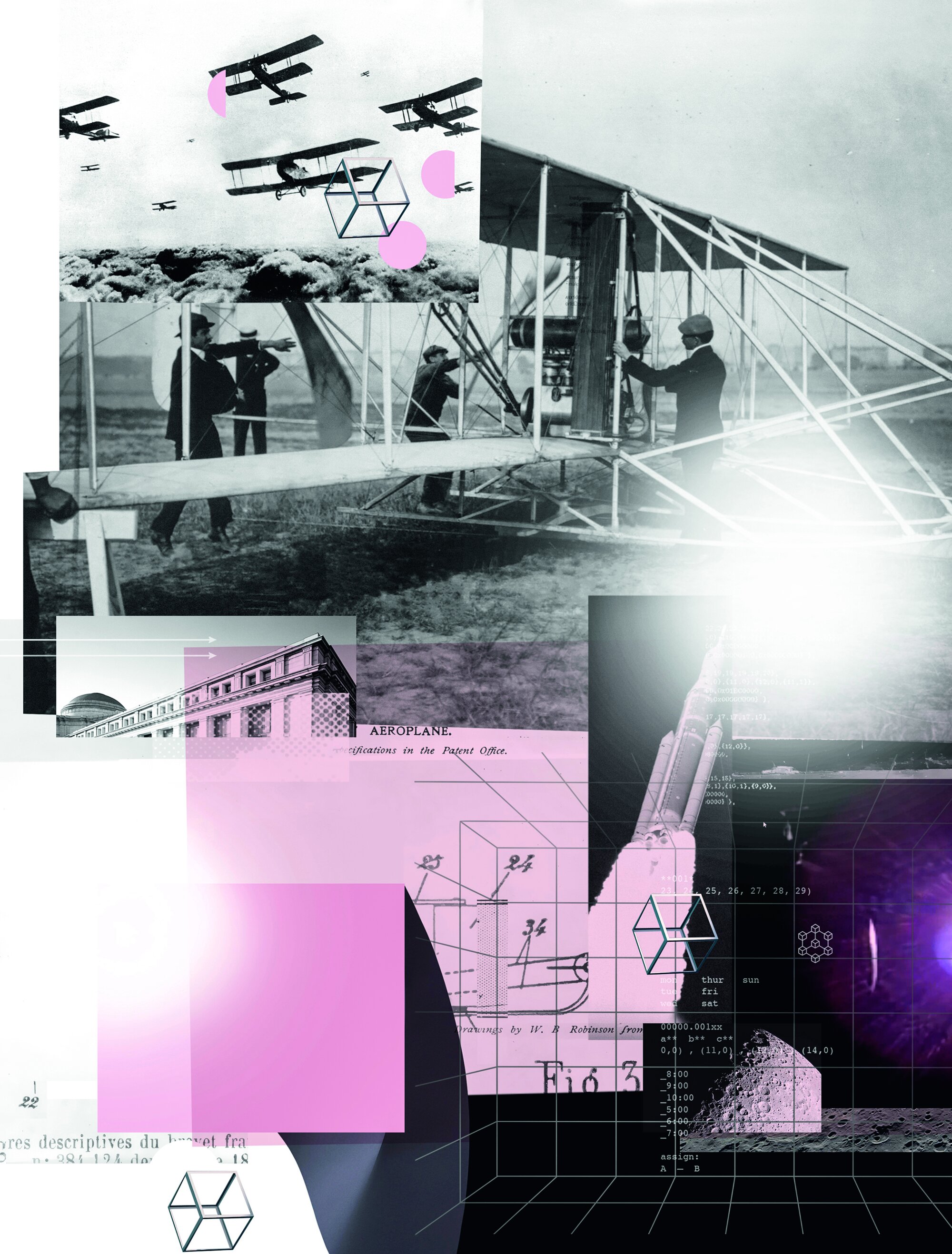

Unter der hohen Decke des Smithsonian-Museums in Washington, D. C., schweben, leicht nach unten geneigt, die mit weißem Stoff bespannten Flügel eines zerbrechlich wirkenden Flugzeugs. Mithilfe seines winzigen Frontmotors hoben die Gebrüder Wright im Dezember 1903 für wenige Sekunden vom Erdboden ab. Nur acht Jahre vergingen, bis italienische Piloten in Libyen Bomben auf feindliche Truppen warfen. Kurz darauf tobten im Ersten Weltkrieg Tausende von Luftkämpfen zwischen wackligen Doppeldeckern.

Ein Jahrhundert später, im Sommer 2017, erschien ein Fachaufsatz, verfasst von Google-Mitarbeitern: „Attention Is All You Need“, eine Anspielung natürlich auf den Beatles-Hit All You Need Is Love. Der Beitrag stellte Transformer vor, eine neue Architektur neuronaler Netze für künstliche Intelligenz (KI). Sie bewirkte den Durchbruch der Large-Language-Modelle (LLMs), also von ChatGPT, Claude und Gemini. Wiederum nur acht Jahre danach sind wir Zeitzeugen der ersten KI-Kriege, von der Ukraine über Venezuela bis zum Iran: LLMs werten Informationen aus, von Satellitenaufnahmen bis zu unzähligen (Video-)Posts in sozialen Netzwerken, so schnell und präzise, wie es keine menschliche Aufklärung vermag. Sie entwerfen Einsatzpläne, identifizieren Ziele für Drohnenangriffe und Luftschläge und steuern sie teilweise auch.

Die Geschichte ist reich an Beispielen für den unmittelbaren Kriegseinsatz neuer Technologien. Ebenso deutlich aber zeigt die Erfahrung, dass bahnbrechende Fortschritte erst aus produktivem Gebrauch resultieren. Am Beispiel des Flugzeugs: Der Aufbau nationaler Luftwaffen ging zwar dem Ausbau des internationalen zivilen Luftverkehrs voraus, doch seit den 1960er Jahren düsen Waren und Menschen um den Planeten, wie es zu Beginn des Jahrhunderts niemand geglaubt hätte. Die Vernetzung durch Luft- und Raumfahrt schuf die erste globale Zivilisation. Ähnlich leben wir nun in den Anfängen einer unvorstellbar „intelligenten“ Zukunft.

Freilich vollzieht sich auch die zivile Adoption der KI rasant. In nur drei Jahren erreichten die LLMs Nutzungszahlen, für die das WWW einst 13 Jahre benötigte. Weltweit arbeiten bereits anderthalb Milliarden Menschen regelmäßig mit KI; in Deutschland sind es 35 Prozent der Erwachsenen, in den USA 52 Prozent. Nutzungsstudien deuten dabei auf einen Effekt hin, den ich aus eigener Erfahrung kenne: Wer KI nutzt, arbeitet schneller, übernimmt ein breiteres Aufgabenspektrum und dehnt seine Arbeitszeit aus – weil die Arbeit mehr Spaß macht und Einzelne plötzlich Dinge erledigen können, für die sie zuvor Hilfe brauchten.

Viele Entwickler schreiben kaum noch selbst Codes. Sie erklären KI-Agenten in natürlicher Sprache, was sie wollen und überlassen ihnen die Umsetzung

Der Umbruch, der derzeit fast alle Bildschirmarbeit erfasst, zeigt sich am deutlichsten in der Softwareentwicklung. Sie hat sich schlagartig verändert. Viele Entwickler schreiben kaum noch selbst Codes. Sie erklären den KI-Agenten in natürlicher Sprache, was sie wollen, und überlassen ihnen die Umsetzung. Unzählige Berichte belegen: Was einst Wochen dauerte, benötigt nur noch Stunden. Der erfahrene Programmierer Steve Yegge erklärte zum Beispiel der New York Times: „Wir sprechen hier von einer zehn- bis 20-fachen – ja sogar 100-fachen – Steigerung meiner Produktivität im Vergleich zu allem, was ich in meiner bisherigen Karriere erreicht habe.“ Radikaler noch ist der Umstand, dass auch die Weiterentwicklung der führenden LLMs von ihnen selbst codiert wird. Boris Cherny, Leiter der Claude-Entwicklung bei Anthropic, diktiert seine Wünsche der KI und begutachtet nur noch das Ergebnis. „Ich schreibe keine einzige Zeile von Hand und bin dabei so ziemlich der produktivste Programmierer im Team“, sagt er. „Es ist eine fremdartige Intelligenz, mit der wir gerade erst zu arbeiten lernen.“

Verbreitet ist der Eindruck, diese fremde Intelligenz sei erst vor Kurzem über die Welt hereingebrochen. Was wir erleben, sind jedoch die Früchte jahrzehntelanger Entwicklung, deren Endpunkt die LLMs keineswegs darstellen. Das Beste, so lässt die Evolution der KI vermuten, kommt noch. Bisher verlief die Entwicklung in vier Phasen von traditionellen Top-down- zu innova-tiven Bottom-up-Ansätzen. Die ersten Versuche, menschliches Fachwissen in Algorithmen zu repräsentieren, begannen Mitte der 1960er Jahre. Programmierte Expertensysteme fanden zum Beispiel Einsatz als Entscheidungshelfer in der medizinischen Diagnostik oder bei der geologischen Suche nach Rohstoffen. Ihr Schwachpunkt war die Überführung von Fachwissen, das oft intuitiv und implizit ist, in explizite „Wenn-dann“-Logiken.

Diese Probleme führten in der Forschung zu einer Umorientierung: auf gänzlich autonome Infrastruktursysteme und auf Kooperationssysteme. Seit den 1980er Jahren steuert, balanciert und optimiert KI etwa Strom- und Telekommunikationsnetze. Und seit den 1990er Jahren existieren kooperative Systeme, die Wissen und Fähigkeiten von Menschen und Maschinen interaktiv bündeln. Solche KIs unterstützen etwa Fluglotsen bei der Staffelung der Flugbewegungen. Andere erleichtern menschliches Entwerfen im Computer-Aided Design (CAD) und schlagen dabei auch eigene Konstruk-tionen vor oder simulieren Materialermüdung.

Parallel dazu schritt die Erforschung von LLMs voran. Statt die Realität in Regeln zu erfassen, basieren LLMs auf statistischen Beschreibungen von Wahrscheinlichkeitsmustern. Die grundlegenden Deep-Learning-Algorithmen stammen bereits aus den letzten Jahrzehnten des 20. Jahrhunderts. Doch für lange Zeit fehlten die ungeheuren Datenmengen, die ein mehrschichtiges Training neuronaler Netze erfordert. Den Durchbruch bewirkten drei Faktoren. Innovativ war erstens um 2010 die Idee des Neurowissenschaftlers und Game-Designers Demis Hassabis, Deep-Learning-KIs in den virtuellen Umgebungen digitaler Spiele zu trainieren. Das Konzept führte, nachdem Google Hassabis’ Firma DeepMind 2014 aufgekauft hatte, über AlphaGo (2015–16) zum Proteinstrukturvorhersage-Programm AlphaFold (2018–20) und schließlich 2024 zu einem Chemienobelpreis.

Der zweite Entwicklungsschub setzte 2017 mit der Transformer-Architektur ein. Sie erlaubt erstmals die parallele Verarbeitung großer Datensätze sowie deren Kontextualisierung. Solchen Datenmengen war allerdings außerhalb der Kunstwelten digitaler Spiele immer noch schwer beizukommen. Der dritte Faktor war daher der Entschluss zum „digitalen Raubrittertum“. Führende Firmen wie OpenAI und Anthropic sammelten seit den frühen 2020er Jahren durch aggressives Web-Scraping und Scannen angekaufter Druckwerke gewaltige Datenmengen. Mit dieser „ursprünglichen Akkumulation“ transformierten sie geistiges Eigentum massenhaft in algorithmisches Kapital – im gesetzlichen Graubereich. Klagen konnten nicht ausbleiben. Anthropic akzeptierte im vergangenen Jahr eine Straf- und Ausgleichszahlung in Höhe von 1,5 Milliarden Dollar. Andere juristische Verfahren laufen noch.

Der menschlichen Intelligenz bleibt es vorbehalten, die Ergebnisse zu beurteilen

Keine Geldstrafe kann jedoch im Nachhinein etwas daran ändern, dass LLMs mit jedem Tag mehr unsere Wissensgesellschaft grundlegend verändern. Und zwar auf einzigartige Weise. Denn anders als vorherige digitale Entwicklungsschübe erfordern sie nicht primär technische Fähigkeiten und die Einarbeitung in neue Soft- und Hardware. LLMs belohnen vielmehr Erfahrung, sprachliche Befähigung und kritische Skepsis. Wer mit ihnen erfolgreich arbeiten will, muss wissen, was auf dem jeweiligen Fachgebiet wichtig und richtig ist und was nicht, und in der Lage sein, daraus die angemessenen Konsequenzen abzuleiten. Exemplarisch zeigte sich dies jüngst bei einem von Anthropic veranstalteten Hackathon. Von 13.000 Bewerbern wurden 500 zugelassen, die meisten professionelle Software-entwickler. Unter den erfolgreichsten Teilnehmern befanden sich indes ein kalifornischer Anwalt, ein ugandischer Straßentechniker und ein belgischer Kardiologe – alle drei ohne jede Programmiererfahrung.

Der Arzt hörte auf dem Weg zur Arbeit von dem Wettbewerb. Seine Expertise war nicht technischer, sondern klinischer Natur: die Erkenntnis aus Tausenden von Beratungen, dass Patienten nur die Hälfte aller ärztlichen Erklärungen behalten und davon wiederum rund 15 Prozent fehlerhaft erinnern. Innerhalb einer Woche entwickelte er eine funktionierende Anwendung. Sie erläutert der Mehrheit der Patienten, die Nachfragen haben, ihre individuellen Diagnosen und Therapien; zu jeder Tages- und Nachtzeit, fehlerfrei und geduldig.

Selbstverständlich betrifft die Hilfestellung durch KI nicht nur Software. LLMs können die meisten Arbeiten unterstützen oder auch selbstständig erledigen, bei denen es darum geht, irgendetwas mit einem gesicherten Standard abzugleichen: die Bearbeitung von Anträgen aller Arten, die Begutachtung von Versicherungsfällen, die Einschätzung von Verträgen, die Abfassung von Steuererklärungen, die Beobachtung von Sicherheitskameras, die Inspektion von Bauten und Maschinen, die Verarbeitung wissenschaftlicher Daten, die in der Realität oder in Laborexperimenten gemessen werden. Der menschlichen Intelligenz bleibt es vorbehalten, die Ergebnisse zu beurteilen und aus ihnen die erfahrungsgemäß besten Konsequenzen zu ziehen.

Ein spektakuläres Beispiel gab diesen Februar die Verbindung von OpenAIs GPT-5 mit einem autonomen Labor von Ginkgo Bioworks. Ein Resultat war die 40-prozentige Kostensenkung der medizinisch wichtigen Proteinproduktion. Bedeutender aber war der Zeitgewinn, wie Ole Lehmann schreibt: „Ein menschlicher Forscher könnte in einem guten Monat vielleicht 20 bis 30 Kombinationen testen. Dieses System testete 6000 pro Iteration … rund 150 Jahre traditionelle Laborarbeit komprimiert auf wenige Wochen.“ Die Konsequenzen für die pharmazeutische Forschung liegen auf der Hand. Aber auch die jahrzehntelange Debatte um die Zukunft künstlicher Intelligenz erscheint in neuem Licht. Bislang nahm man eine linear aufsteigende Linie an. Was seit Jahrzehnten existiert, sind vier Varianten „schwacher“ KI: Expertensysteme, Infrastruktursysteme, koope-rative Systeme und generative Systeme, insbesondere LLMs. Die angestrebte nächste Stufe war eine „starke“ oder „allgemeine“ KI auf menschenähnlichem Niveau; gefolgt von einer teils erhofften, teils gefürchteten künstlichen Superintelligenz, die menschliche Kapazitäten exponentiell übertrifft.

Was wir nun aber – recht plötzlich – bekommen haben, sind Systeme, die menschenähnliche Sprachfähigkeit mit den informationsverarbeitenden „Superkräften“ eines Computers verbinden. Sie lesen, verstehen und sprechen natürliche Sprache. Sie erkennen komplexe Wissensmuster in Texten aller Sorten. Sie lösen mathematische Probleme, die seit Jahrzehnten ungelöst waren. Sie schreiben Software und verbessern die eigene rekursiv. Sie vollziehen eigenständig wissenschaftliche Experimente und benötigen keinen Tag, um die gesamte Literatur eines Fachgebiets zu erfassen. Ihre Geschwindigkeit, ihr Gedächtnis und ihre Präzision sind „übermenschlich“. Die Vermutung liegt daher nahe, dass wir die zweite Entwicklungsstufe übersprungen haben. Der Wirtschaftswissenschaftler und populäre Substack-Kolumnist Noah Smith schreibt denn auch: „Die Leute diskutieren viel darüber, wann die künstliche Superintelligenz kommen wird. Die Wahrheit ist: Sie ist längst da.“ Und sie erscheint ebenso leistungsstark wie harmlos; harmloser jedenfalls als menschliche Intelligenz.

Prof. Dr. Gundolf S. Freyermuth

lehrt Media and GameStudies und ist Gründungsdirektor des Cologne Game Lab an der TH Köln. In seinem Kultbuch„Cyberland: Eine Führung durch den High-Tech-Underground“ (Rowohlt) beschrieb er bereits 1996 die digitale Zukunft, in der wir heute leben.

Foto: feelimage/Matern