Schnell und präzise

Bei der Erforschung neuer Therapien entstehen riesige Datenmengen. Durch „Artificial Intelligence“ sind diese viel leichter nutzbar

Nicht mehr nur Panzer, Flugzeuge und Soldaten entschieden Kriege. Kriege werden heute mit Daten geführt. Mit Algorithmen. Mit Systemen, die schneller auswerten, priorisieren und entscheiden, als es Menschen je können. Künstliche Intelligenz ist dabei keine ferne Zukunftstechnologie mehr, sondern längst operative Realität. Sie beeinflusst, wie militärische Lagebilder entstehen, wie Ziele ausgewählt werden und wie Streitkräfte ihre knappen Ressourcen einsetzen. Wer heute über Sicherheit spricht, spricht über KI – ob er will oder nicht.

Ein zentrales Missverständnis besteht darin, KI mit autonomen Kampfrobotern gleichzusetzen. Diese Bilder dominieren Filme und Schlagzeilen, sie verstellen aber den Blick auf das Wesentliche. Militärisch relevant ist KI vor allem dort, wo sie menschliche Entscheidungsprozesse unterstützt, beschleunigt und absichert. Genau hier liegt ihre strategische Sprengkraft.

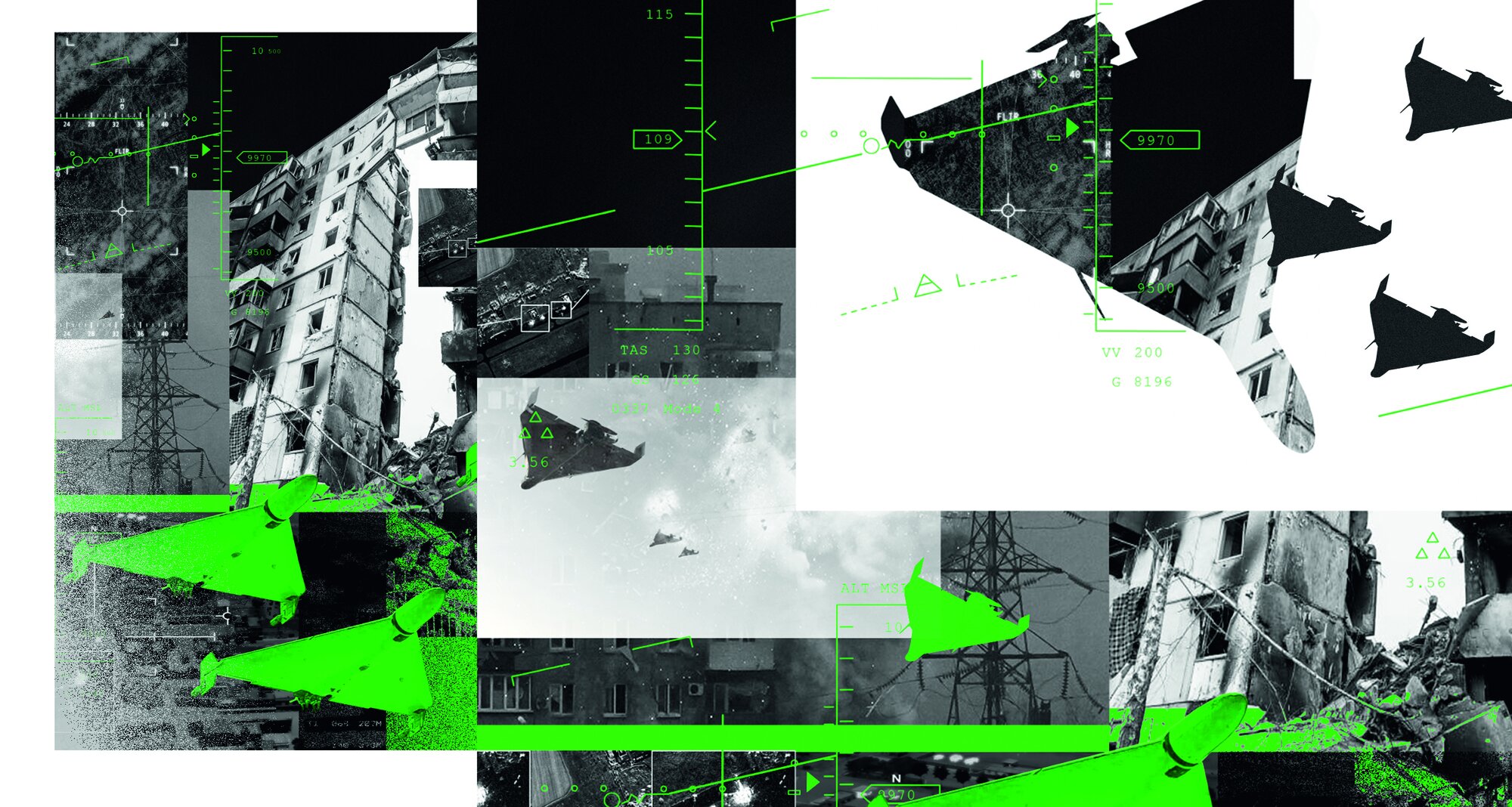

In modernen Konflikten entscheidet Zeit. Sekunden können über Erfolg oder Scheitern einer Mission bestimmen. KI-Systeme analysieren heute große Mengen an Sensordaten: Satellitenbilder, Drohnenaufnahmen, Funksignale, Bewegungsmuster. Sie filtern das Relevante aus dem Rauschen. Sie markieren Auffälligkeiten. Sie schlagen Handlungsoptionen vor. Der Mensch bleibt formal Entscheider, aber er entscheidet auf Basis eines maschinell erzeugten Lagebildes. Wer dieses Lagebild kontrolliert, kontrolliert den Kampf.

Ein praktisches Beispiel ist die Auswertung von Drohnenaufklärung. Früher sichteten Analysten stundenlang Videomaterial. Heute erkennen KI-Modelle Fahrzeuge, Stellungen oder ungewöhnliche Bewegungen automatisch. Das beschleunigt die Aufklärung drastisch. Gleichzeitig steigt der Druck auf den Menschen, der diese Vorschläge prüft. Je besser die Maschine, desto größer die Versuchung, ihr zu vertrauen.

Militärisch setzt sich deshalb kein autonomer Maschinenkrieg durch, sondern das Konzept des „Mensch-Maschine-Teams“. KI übernimmt Wahrnehmung, Vorstrukturierung und Priorisierung. Der Mensch trifft Entscheidungen. In der Theorie ist diese Rollenverteilung klar. In der Praxis verschwimmt sie. Je leistungsfähiger ein System ist, desto stärker prägt es die Entscheidung. Wenn eine KI über Monate hinweg zuverlässig Auffälligkeiten erkennt, sinkt die Bereitschaft, ihre Vorschläge kritisch zu hinterfragen. Aus Assistenz wird faktische Autorität. Genau hier entsteht ein neues ethisches Spannungsfeld: Verantwortung bleibt formal beim Menschen, faktisch aber wird sie durch Systemdesign vorgeprägt.

KI übernimmt Wahrnehmung, Vorstrukturierung und Priorisierung. Der Mensch entscheidet

Für Streitkräfte bedeutet das: Ethik beginnt nicht erst beim Einsatz, sondern bereits bei Architektur, Trainingsdaten und Benutzeroberflächen. Welche Optionen ein System anbietet und welche nicht, beeinflusst Entscheidungen stärker als jede Einsatzregel.

KI wirkt auch jenseits des unmittelbaren Gefechtsfeldes. In der Logistik etwa. Algorithmen prognostizieren Ersatzteilbedarfe, optimieren Nachschubrouten und priorisieren Transporte. Das klingt banal, entscheidet aber über die Durchhaltefähigkeit. Armeen scheitern selten an fehlender Feuerkraft. Sie scheitern an Versorgung, Koordination und Komplexität. KI adressiert genau diese Schwachstellen.

Ein weiteres Feld ist die militärische Planung. KI-gestützte Simulationen analysieren Tausende Szenarien: Was passiert, wenn ein Knotenpunkt ausfällt? Wie reagiert der Gegner auf bestimmte Manöver? Welche Eskalationspfade sind wahrscheinlich? Diese Systeme liefern keine Wahrheit. Sie liefern Wahrscheinlichkeiten. Aber auch das verändert militärisches Denken: Planung wird datengetriebener, dynamischer und potenziell auch enthemmter.

Ein oft unterschätzter Effekt von KI liegt in ihrer beschleu-nigenden Wirkung auf Eskalationsdynamiken. Wenn Entscheidungszyklen schrumpfen, bleibt weniger Zeit für politische Einordnung, diplomatische Intervention oder bewusste Zurückhaltung. Militärische Führung operiert dann nicht mehr im Takt menschlicher Reflexion, sondern im Takt maschineller Verarbeitung. Das verändert das klassische Verhältnis von Politik und Militär grundlegend. Was also früher Tage oder Wochen an Analyse erforderte, geschieht heute in Minuten. Lagebilder aktualisieren sich permanent. Handlungsempfehlungen werden fortlaufend neu berechnet. Der Druck, „nicht hinterherzulaufen“, wächst. In einem solchen Umfeld wird Nichthandeln schnell als Schwäche interpretiert. KI erzeugt damit keinen Automatismus zum Krieg, aber sie verschiebt die psychologischen und organisatorischen Schwellen, die Eskalation bisher gebremst haben. Genau an diesem Punkt verlässt die Debatte den rein militärischen Raum und wird politisch und ethisch.

Es stellt sich die ethische Kernfrage: Bereitet der zunehmende Einsatz von KI „entgrenzte“ Kriege vor?

Die Gefahr liegt weniger in der Maschine selbst als in ihrer Wirkung auf menschliche Entscheidungen. Wenn Krieg effizienter, präziser und scheinbar kontrollierbarer wird, sinkt die politische Hemmschwelle. Wenn Verluste auf eigener Seite reduziert werden, steigt die Bereitschaft zum Einsatz militärischer Mittel. KI kann Distanz schaffen – emotional, moralisch, politisch. Entscheidungen fallen im Serverraum, nicht mehr im Schützengraben.

Rechtlich und politisch bleibt Verantwortung nicht delegierbar. Auch wenn Algorithmen Ziele priorisieren oder Risiken bewerten: Am Ende entscheidet ein Mensch, eingebettet in Befehlsketten, Einsatzregeln und parlamentarische Kontrolle. Die Vorstellung eines vollständig entkoppelten Maschinenkrieges ist technisch überzeichnet und rechtlich nicht haltbar. Völkerrecht, Einsatzregeln und militärische Führungsprinzipien gelten weiterhin. Sie stehen aber unter Anpassungsdruck.

Zurück zur Frage: Bereitet KI also nun entgrenzte Kriege vor? Die ehrliche Antwort lautet: Sie kann es ermöglichen, wenn sie falsch eingesetzt wird. Entgrenzung entsteht nicht durch Technik, sondern durch ihre politische Einbettung. KI senkt Kosten, beschleunigt Prozesse und reduziert sichtbare Risiken. All das kann dazu beitragen, militärische Gewalt als „handhabbarer“ erscheinen zu lassen.

Gleichzeitig bietet KI auch Chancen zur Begrenzung: bessere Lagebilder, präzisere Wirkungen, geringere Kollateralschäden. Ob KI zur Eskalation oder zur Kontrolle beiträgt, ist keine technische, sondern eine normative Entscheidung.

KI schafft nicht nur Vorteile, sie erzeugt neue Verwundbarkeiten. Algorithmen sind abhängig von Daten. Daten können manipuliert, verfälscht oder gezielt eingespeist werden. Täuschung wird damit digitalisiert. Ein manipuliertes Lagebild kann gefährlicher sein als gar keines.

Eldar Sultanow: Vom Schlachtfeld bis zum Serverraum

Plassen Verlag 2026, Taschenbuch, 224 Seiten, 19,90 Euro

PR

Hinzu kommt die technische Fragilität komplexer Systeme. Stromausfälle, Cyberangriffe oder fehlerhafte Updates können operative Abhängigkeiten offenlegen. Wer sich blind auf KI verlässt, riskiert Kontrollverlust. Militärische Resilienz bedeutet daher auch, bewusst mit Unschärfe, Re-dundanz und menschlicher Intuition zu arbeiten – Fähigkeiten, die im KI-Zeitalter leicht verlernt werden.

Für die Bundeswehr ist KI kein Zukunftsthema, sondern eine strategische Notwendigkeit. Sie muss KI verstehen, beherrschen und kritisch reflektieren – nicht nur einkaufen. Dazu gehören eigene Kompetenzen, eigene Datenräume und in sicherheitskritischen Bereichen auch eigene Modelle. Abhängigkeiten von fremden Technologien bergen sicherheitspolitische Risiken.

Gleichzeitig steht die Bundeswehr als Parlamentsarmee in besonderer Verantwortung. Transparenz, Nachvollziehbarkeit und politische Kontrolle müssen auch dann gewährleistet bleiben, wenn Entscheidungsprozesse technisch komplexer werden. KI darf militärische Führung unterstützen, sie darf sie nicht entziehen.

KI macht Krieg nicht unmenschlich. Sie verstärkt das, was Menschen aus ihr machen. Sie kann Eskalation beschleunigen oder Kontrolle verbessern. Sie kann Verantwortung verschleiern oder Entscheidungen transparenter machen. Entscheidend ist, ob Demokratien den Einsatz dieser Technologien aktiv gestalten oder ihnen passiv hinterherlaufen.

KI verändert, wie Kriege geführt werden und wie über Krieg entschieden wird. Gerade deshalb darf ihre Gestaltung nicht allein Militärs und Ingenieuren überlassen bleiben, sondern gehört ins Zentrum demokratischer Verantwortung.

Der Krieg der Zukunft beginnt nicht mit dem ersten Schuss. Er beginnt mit Daten, mit Code und mit Architekturentscheidungen in Rechenzentren. Wer Sicherheit ernst nimmt, muss diese neue Realität anerkennen und sie politisch, militärisch und ethisch gestalten. Alles andere wäre fahrlässig.

Dr. Eldar Sultanow

ist IT-Stratege bei einer der weltweit führenden Beratungsgesellschaften für digitale Transformation und Gutachter für das Deutsche Zentrum für Luft- und Raumfahrt (DLR). Er blickt auf mehr als 20 Jahre Erfahrung in der professionellen Softwareentwicklung zurück: von der Programmierung bis zum KI-Design. Sultanow lebt in Bayern auf dem Land, liebt Tauchen, Reisen und die Natur.

Foto: Privat